可信AI年度观察 | 生成式AI技术及产品快速迭代,生成内容质量及安全性仍需提升

自2021年起,生成式人工智能(以下简称“生成式AI”)连续两年入选Gartner《Hype Cycle for Artificial Intelligence》,被认为是未来重要的AI技术趋势。2022年以来,生成式AI产品不断涌现,生成内容模态多样,国内外头部科技企业竞相布局。生成式AI产品在快速发展过程中,在生成内容可控性、合规性等方面仍存在不足。中国信息通信研究院(以下简称“中国信通院”)联合中国人工智能产业发展联盟(以下简称“联盟”),基于生成式AI研究基础,总结了生成式AI技术及应用发展现状与趋势。

一、2022年生成式AI发展观察

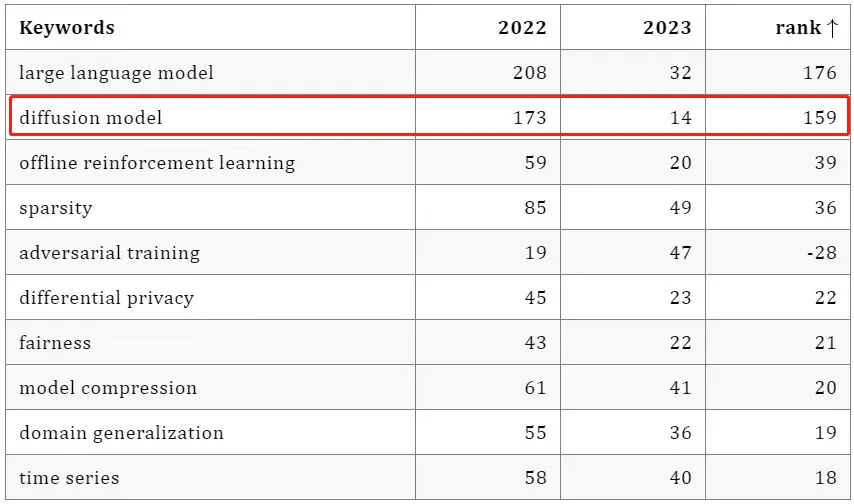

扩散模型Diffusion(以下简称“扩散模型”)和神经网络模型CLIP结合,文生图实现质变。扩散模型能够缩短训练时长、使图像生成更具多样性,具备保留数据语义结构的能力。神经网络模型CLIP可匹配图像和文本,与扩散模型结合可加快文本生成图片速度。近一年来,扩散模型成为研究热潮,在人工智能顶级会议ICLR 2023中,“Diffusion Model”在论文题目关键词频率排名从去年的第159名上升到14名[1]。

图1:ICLR2023投稿论文关键词Top10排名,图片来自网络

生成模态不断更新,呈现多元化格局。按照生成模态划分,生成式AI产品分为文本生成、图片生成、代码生成和音频生成多个方向。随着技术的不断发展,生成模态种类不断扩展。2022年9月Meta发布自研视频生成大模型Make-A-Video;2022年11月,NVIDIA公司发布了3D模型生成工具Magic3D;同月WebAR软件平台解决方案商Geenee AR发布了AI WebAR内容创造套件RT3D AI SDK。

2.国内外产品各具特色,交互体验不断升级

生成式AI产品在交互设计中,更注重用户体验。目前生成式AI产品形态包含插件、API网页交互、客户端等。其中,API网页交互无需下载安装产品,在云端即可获得生成内容,如用户可在百度的“文心ERNIE 3.0”产品网页中输入提示词生成内容。同时,生成式AI技术与搜索产品融合后,匹配内容、意图理解表现更好。例如,用户使用论文阅读助手SciSpace时,无需指定关键词即可搜索和查找相关论文,可提升阅读论文效率。

文本生成类应用在生成可控性、准确率等方面仍表现不足。文本生成类应用仍存在生成内容准确率低、可控性低等问题。例如,著名技术交流论坛Stack Overflow曾临时禁止ChatGPT回答编程问题。图片生成类应用则存在作品版权争议较大、生成内容细节不足等问题。AI创作时会大量借鉴绘画、漫画名作,其生成内容与原作风格相似度较高,版权界定尚不清晰。例如著名艺术家网站ArtStation已有艺术家呼吁删除站内所有AI绘画作品。同时,AI作品在细节表现上仍存在不足,例如某些图片生成的应用中,生成内容将动物和物品、真实和卡通混淆。

二、中国信通院生成式AI方向工作有序开展

2022年12月初,为便于产学研各方快速了解ChatGPT内容生成能力,中国信通院对ChatGPT展开评测,从技术能力和产品能力两个关键模块切入。技术能力选取创意写作、命题写作、摘要生成和代码生成四大任务类型,以数据集测试的方式评测ChatGPT的可接受率。产品评测关注用户体验,邀请评分人员对生成内容的可读性、主观性等方面打分。测评结果显示,ChatGPT在创意写作等开放域内容创作表现较好,而面对约束条件如摘要生成、代码纠错时生成能力仍有限。关于本次评测的更多详情,可访问文章:

可信AI评测观察:ChatGPT生成能力|开放域内容创作表现较好,但在约束条件下生成能力仍有不足

图2:ChatGPT生成能力评测成果

近年来,生成式AI行业发展迅速,覆盖数据模态不断扩展,生成内容愈发具有创造力、多元化。另一方面,部分生成式AI应用的产品能力仍存在不足,数据合规性、安全性也需进一步规范。中国信通院与联盟高度重视生成式AI技术及发展走向,于2022年11月启动生成式AI标准编制工作。希尔贝壳以及来自学术界、产业界的50余家单位积极参与标准编制。

图3:生成式AI标准报名参编单位一览

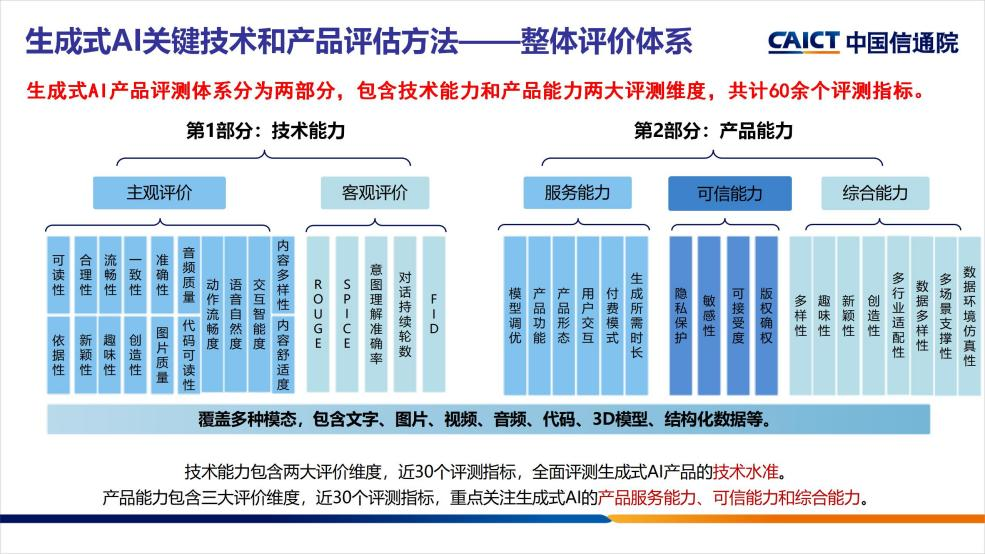

生成式AI标准体系初步形成,标准编制工作正在进行。生成式AI标准分为技术能力和产品能力两部分,全面评测产品的技术能力和产品水准。技术能力部分按照生成模态划分,通过主观评价和客观评价两大维度全面评测生成式AI产品的技术水平。产品能力重点关注生成式AI产品的服务能力、可信能力和综合能力。其中服务能力关注产品功能、用户交互和付费模式等指标;可信能力中加入隐私保护、生成数据合规性、安全性等指标;综合能力关注多行业适配性、多样性等指标。

图4:生成式AI标准框架

参考文献:

1. ICLR 2023 OpenReview 投稿文章一览:https://github.com/EdisonLeeeee/ICLR2023-OpenReviewData